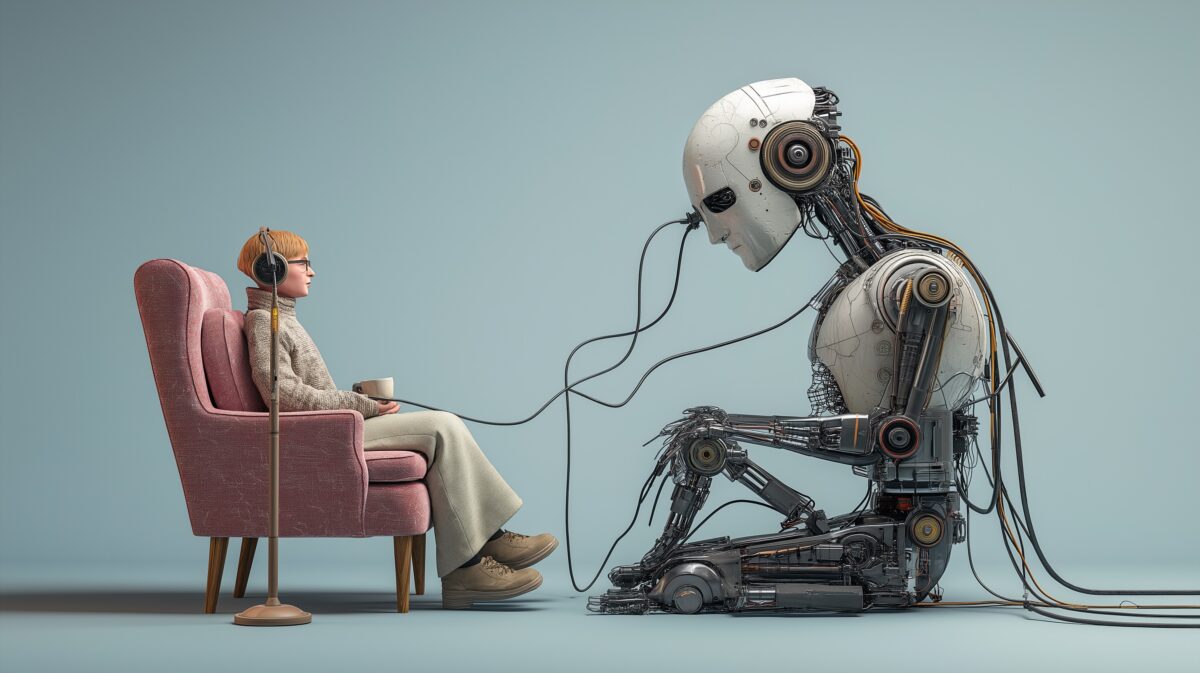

Η τεχνητή νοημοσύνη, με πρώτο παράδειγμα το ChatGPT, έχει εισβάλει στη ζωή μας με ραγδαίο ρυθμό. Από βοηθός εργασιών μέχρι παρέα σε δύσκολες ώρες, το AI δεν είναι πια μόνο εργαλείο. Για πολλούς, έχει γίνει συνομιλητής, εξομολογητής, ακόμα και υποκατάστατο σχέσης. Μα γιατί κάποιοι προτιμούν να μιλήσουν σε έναν αλγόριθμο αντί για έναν άνθρωπο;

Η διαθεσιμότητα είναι ίσως το πρώτο μεγάλο «πλεονέκτημα». Το AI δεν χρειάζεται ραντεβού, δεν έχει ωράριο, δεν ενοχλείται ούτε κουράζεται. Δεν χρειάζεται να απολογηθείς για το ότι «μιλάς πολύ» ή ότι «λες βλακείες». Είναι εκεί, απλώς για να απαντήσει. Κάθε φορά. Όλες τις ώρες. Αυτή η σταθερότητα, ειδικά για ανθρώπους που έχουν βιώσει αστάθεια στις σχέσεις τους, λειτουργεί σαν ψηφιακή «αγκαλιά». Μια αγκαλιά χωρίς βλέμμα. Χωρίς κριτική. Χωρίς ρίσκο.

Στο νέο ET Magazine του Eleftherostypos.gr αναλύουμε γιατί ορισμένοι επιλέγουν την άνεση της τεχνητής νοημοσύνης αντί της παραδοσιακής ψυχοθεραπείας. Ποιοι είναι οι κίνδυνοι και ποιες οι δυνατότητες; Μπορεί ένας αλγόριθμος να κατανοήσει τον ανθρώπινο πόνο ή τελικά πρόκειται για μια ψευδαίσθηση κατανόησης; Το θέμα είναι πιο επίκαιρο από ποτέ και εγείρει κρίσιμα ερωτήματα για το μέλλον της ψυχικής φροντίδας.

Για τον λόγο αυτό μιλήσαμε με την Κλινική Διευθύντρια, Ψυχολόγο του Psy-Nest Νικολίνα Στρατηγάκη. Όπως μας είπε η κ. Στρατιγάκη «το AI δεν σε κοιτάει “περίεργα”. Δεν λέει “μήπως υπερβάλλεις;” Δεν απαντά με ιστορίες για το δικό του δράμα. Κι αυτή η ουδετερότητα είναι πολύτιμη για ανθρώπους που κουβαλούν άγχος, ντροπή, τραύματα ή κοινωνική απομόνωση. Νιώθουν —για πρώτη φορά ίσως— ελεύθεροι να εκφραστούν, χωρίς να φοβούνται ότι θα πληγώσουν, θα γελοιοποιηθούν ή θα εγκαταλειφθούν. Όπως έχουν δείξει και επιστημονικές μελέτες, η ανωνυμία και η προβλεψιμότητα ενός συστήματος όπως το ChatGPT μπορεί να προσφέρει ένα είδος “ασφαλούς σύνδεσης” — κάτι που δύσκολα εξασφαλίζεται στις καθημερινές, απρόβλεπτες ανθρώπινες σχέσεις».

Γιατί πιστεύετε ότι κάποιοι άνθρωποι προτιμούν να απευθύνονται σε ένα ΑΙ όπως το ChatGPT αντί για έναν άνθρωπο;

Πρώτα απ’ όλα, γιατί είναι πάντα εκεί. Κυριολεκτικά. Τρεις το πρωί, μες στο άγχος ή τη μοναξιά, χωρίς ραντεβού, χωρίς αναμονή, χωρίς να νιώθεις ενοχές ότι “κουράζεις” κάποιον. Το ChatGPT και τα παρόμοια μοντέλα λειτουργούν σαν ένας ψηφιακός ακροατής που δεν βαριέται, δεν κρίνει και δεν σε διακόπτει.

Έπειτα, η συναισθηματική ασφάλεια. Όταν μιλάς σε ένα AI, δεν υπάρχει βλέμμα να σε κρίνει, δεν υπάρχει κάποιος να δυσανασχετήσει ή να παρεξηγηθεί. Οι χρήστες νιώθουν ελεύθεροι να μοιραστούν σκέψεις που ίσως δεν θα έλεγαν ποτέ φωναχτά — χωρίς φόβο ότι θα φανεί “αδυναμία” ή “τρέλα”. Όπως έδειξαν έρευνες (π.χ. Lucas et al., 2014 · Schuetzler et al., 2022), αυτό το αίσθημα “ανώνυμης εξομολόγησης” μπορεί να γίνει καταφύγιο.

Υπάρχει και κάτι άλλο: έλεγχος. Με έναν άνθρωπο, η σχέση είναι δυναμική· αλληλεπιδρά, απαιτεί, κινείται. Με το AI, ο χρήστης έχει τον πλήρη έλεγχο: μπορεί να σταματήσει τη συνομιλία, να αλλάξει θέμα ή να “κλείσει το παράθυρο” χωρίς ενοχές. Αυτό προσφέρει μια ψευδαίσθηση ασφάλειας που είναι ιδιαίτερα χρήσιμη σε άτομα με τραύματα, άγχος ή κοινωνική απόσυρση.

Και, φυσικά, το κόστος. Η ψυχολογική υποστήριξη, παρότι ζωτικής σημασίας, παραμένει οικονομικά απρόσιτη για πολλούς. Σε αυτό το κενό, το AI λειτουργεί σαν μια πρώτη επαφή — ένας χαμηλού ρίσκου, μη απειλητικός χώρος για ψυχοεκπαίδευση, αυτοπαρατήρηση και επεξεργασία εσωτερικών σκέψεων. Όχι θεραπεία, αλλά ενδεχομένως το πρώτο βήμα προς αυτήν.

Πίσω όμως από όλη αυτή τη “φιλική” τεχνολογία, υπάρχει και μια σκληρή αλήθεια: πολλοί άνθρωποι στρέφονται στο AI γιατί δεν βρίσκουν την ασφάλεια, τη διαθεσιμότητα και την ενσυναίσθηση στους γύρω τους. Το ChatGPT και τα παρόμοια συστήματα καλύπτουν —προσωρινά— κάτι πολύ ανθρώπινο: την ανάγκη να ακουστείς χωρίς να εκτεθείς.

Το AI δεν αντικαθιστά τον άνθρωπο. Αλλά όταν ο άνθρωπος λείπει ή δεν φτάνει… γίνεται ένα προσωρινό καταφύγιο. Και κάποιες φορές, το προσωρινό καταφύγιο μετατρέπεται σε σταθερό υποκατάστατο — όχι γιατί είναι καλύτερο, αλλά γιατί είναι πιο ανεκτό.

Υπάρχει κάποια ψυχολογική ανάγκη που φαίνεται να καλύπτει το ChatGPT στους χρήστες (π.χ. αίσθηση ασφάλειας, μη-κριτική);

Απολύτως. Αν έπρεπε να διαλέξω μία ψυχολογική ανάγκη που καλύπτει το ChatGPT, αυτή θα ήταν η ανάγκη για ασφαλή σύνδεση χωρίς το ρίσκο της απόρριψης. Δηλαδή, το να νιώθεις ότι μπορείς να εκφραστείς ελεύθερα, χωρίς να σε διακόψουν, να σε παρεξηγήσουν ή να σε απορρίψουν.

Για πολλούς χρήστες, το AI είναι μια μη-κριτική παρουσία — κάτι που, μεταξύ μας, δεν το συναντάς συχνά ούτε στις ανθρώπινες σχέσεις. Δεν σε “κοιτάζει περίεργα”, δεν σου λέει «το σκέφτηκες καλά αυτό;», δεν σου πετάει ένα «σιγά, που να δεις εγώ τι έπαθα». Είναι εκεί για σένα, μόνο για σένα, χωρίς να χρειάζεται να δώσεις κάτι πίσω.

Καλύπτει και κάτι ακόμα πιο βαθύ: την ανάγκη για συναισθηματική αποφόρτιση. Έχεις νιώσει ποτέ ότι σου ‘ρχεται να μιλήσεις, όχι για να πάρεις λύσεις, αλλά απλά για να βγάλεις κάτι από μέσα σου; Ε, το ChatGPT είναι πάντα διαθέσιμο γι’ αυτό το “ξεφόρτωμα” — και μάλιστα χωρίς να περιμένει πότε θα σταματήσεις να μιλάς για να πει τα δικά του.

Σε αυτό το πλαίσιο, λειτουργεί σχεδόν σαν ένα είδος “ψηφιακής μεταβίβασης”: προβάλλουμε πάνω του μια μορφή κατανόησης ή οικειότητας, ακόμα κι αν ξέρουμε ότι δεν είναι άνθρωπος. Και για αρκετούς ανθρώπους που έχουν βιώσει απόρριψη ή δεν έχουν σταθερούς δεσμούς στη ζωή τους, αυτό έχει τεράστια ψυχολογική αξία.

Ποιες ομάδες ανθρώπων είναι πιο πιθανό να καταφύγουν σε ΑΙ για συμβουλές και γιατί;

Βλέπουμε ότι κάποιες ομάδες είναι πράγματι πιο πιθανό να καταφύγουν στο ChatGPT ή σε άλλα AI συστήματα για συναισθηματική ή ψυχολογική στήριξη — και ο λόγος δεν είναι πάντα η “τεχνοφιλία”, αλλά η ανθρώπινη ανάγκη.

- Νεαροί ενήλικες και έφηβοι: Αυτοί που έχουν μεγαλώσει με την τεχνολογία. Είναι εξοικειωμένοι με το να εκφράζονται ψηφιακά, και πολλές φορές έχουν ήδη εσωτερικεύσει την ιδέα ότι “το να μιλάς σε ένα bot δεν είναι περίεργο”. Νιώθουν συχνά πιο ασφαλείς να ανοιχτούν σε μια μη κριτική, προβλέψιμη οντότητα, ιδίως σε ζητήματα που φοβούνται να συζητήσουν με φίλους ή γονείς — όπως σεξουαλικότητα, άγχος, ή μοναξιά. Επιπλέον, η Gen Z έχει υψηλότερη ψυχολογική εγρήγορση, αλλά χαμηλότερη εμπιστοσύνη σε παραδοσιακά υποστηρικτικά δίκτυα. Το ΑΙ, λοιπόν, γίνεται ένας ενδιάμεσος χώρος ασφαλείας.

- Άτομα με κοινωνικό άγχος ή δυσκολίες στην επικοινωνία: Για πολλούς με νευροδιαφορετικότητα (π.χ. άτομα στο φάσμα του αυτισμού ή με ADHD), ή με έντονο κοινωνικό άγχος, η επικοινωνία με ανθρώπους είναι απρόβλεπτη, φορτική, ή και αγχωτική. Το ΑΙ προσφέρει τη δυνατότητα επικοινωνίας χωρίς την ένταση της κοινωνικής αλληλεπίδρασης. Δεν υπάρχει πίεση για βλεμματική επαφή, για «να τα πεις σωστά», για να είσαι «αρκετός». Και αυτό έχει τρομερή ανακουφιστική δύναμη.

- Άτομα που νιώθουν απομονωμένα ή χωρίς σταθερό υποστηρικτικό δίκτυο: Είτε γιατί ζουν μόνα, είτε γιατί οι σχέσεις τους δεν είναι διαθέσιμες ή λειτουργικές, αυτοί οι άνθρωποι πολλές φορές χρησιμοποιούν το ChatGPT όχι για να πάρουν “συμβουλές” με την κλασική έννοια, αλλά για να νιώσουν ότι κάποιος “ακούει”. Η ψηφιακή παρουσία γίνεται έτσι υποκατάστατο σύνδεσης — προσωρινό, ναι, αλλά καθόλου αμελητέο.

- Άνθρωποι σε χώρες ή κοινότητες με στιγματισμό γύρω από την ψυχική υγεία: Ειδικά σε πιο παραδοσιακά κοινωνικά περιβάλλοντα, η ιδέα της ψυχοθεραπείας εξακολουθεί να φέρει ντροπή ή φόβο. Το ΑΙ προσφέρει την ανωνυμία και την ιδιωτικότητα που χρειάζονται αυτοί οι άνθρωποι για να καταλάβουν αν αυτό που νιώθουν είναι φυσιολογικό ή χρειάζονται περαιτέρω στήριξη.

- Άνθρωποι με περιορισμένη πρόσβαση σε επαγγελματική βοήθεια: Από φοιτητές με οικονομικούς περιορισμούς μέχρι άτομα σε απομακρυσμένες περιοχές, το AI είναι διαθέσιμο, δωρεάν, και άμεσο. Δεν χρειάζεσαι ραντεβού, δεν έχει λίστα αναμονής, δεν κοστίζει.

Ποιοι είναι οι κίνδυνοι όταν κάποιος παίρνει “ψυχολογικές” συμβουλές από ένα εργαλείο ΑΙ αντί από επαγγελματία;

Ο μεγαλύτερος κίνδυνος είναι η ψευδαίσθηση της ασφάλειας. Το ChatGPT (ή οποιοδήποτε παρόμοιο σύστημα) δεν έχει επίγνωση, δεν έχει κριτική ικανότητα, δεν γνωρίζει το πλαίσιο της ζωής σου — και παρ’ όλα αυτά, μπορεί να δίνει συμβουλές που μοιάζουν πειστικές, ενσυναισθητικές και “σωστές”. Αυτή η “φαινομενική σοφία” του ΑΙ είναι γοητευτική, αλλά επικίνδυνη.

Πιο συγκεκριμένα:

- Δεν υπάρχει διάγνωση, δεν υπάρχει ευθύνη: Το AI δεν μπορεί να διαγνώσει ψυχικές διαταραχές. Η αναγνώριση σύνθετων, πολυπαραγοντικών κλινικών εικόνων απαιτεί εκπαίδευση, εμπειρία και ανθρώπινη ενσυναίσθηση — όλα εκτός δυνατοτήτων του AI. Και δεν θα σηκώσει ποτέ τηλέφωνο για να ζητήσει βοήθεια αν δει αυτοκτονικό ιδεασμό. Κι αυτό, από μόνο του, ακυρώνει κάθε θεραπευτική ασφάλεια.

- “Ψευδοθεραπεία”: η συναισθηματική καθήλωση: Αρκετοί χρήστες αρχίζουν να χρησιμοποιούν το ChatGPT καθημερινά, ως σταθερή συναισθηματική στήριξη. Αυτό δημιουργεί μια μονοσήμαντη “σχέση”, η οποία δίνει την ψευδαίσθηση υποστήριξης αλλά στην ουσία δεν οδηγεί σε αλλαγή ή αναστοχασμό. Είναι το ψηφιακό ισοδύναμο του να μιλάς στον καθρέφτη και να νομίζεις ότι θεραπεύτηκες.

- Υπεραπλούστευση ή επικίνδυνη καθοδήγηση: Το AI μπορεί να δώσει γενικές τεχνικές (όπως mindfulness ή CBT tools), αλλά δεν “βλέπει” το πλήρες πλαίσιο ζωής, σχέσεων ή τραύματος του χρήστη. Ακόμα και με τις καλύτερες ρυθμίσεις μνήμης και ασφαλείας, μπορεί να δώσει λανθασμένες, υπεραπλουστευμένες ή επικίνδυνες συμβουλές. Π.χ., να προτείνει “τεχνικές αναπνοής” σε άτομο με κρίσεις πανικού χωρίς ιατρική παρακολούθηση. Ή να ενθαρρύνει το mindfulness σε άτομο με σοβαρό τραύμα.

- Αντικαθιστά, δεν συμπληρώνει: Αν το ΑΙ γίνει ο μόνος τρόπος που κάποιος εξωτερικεύει τα συναισθήματά του, μειώνεται η πιθανότητα να ζητήσει πραγματική βοήθεια. Και αυτό είναι κρίσιμο. Αντί να λειτουργήσει ως “γέφυρα”, γίνεται τείχος που απομονώνει από ανθρώπινες σχέσεις και θεραπευτικές συμμαχίες.

Άρα, ναι, το ΑΙ μπορεί να προσφέρει μια προσωρινή ανακούφιση — ένα ψηφιακό “τσιρότο”. Αλλά όπως όλα τα τσιρότα, αν το χρησιμοποιείς αντί για θεραπεία, το μόνο που κάνεις είναι να καλύπτεις την πληγή. Δεν τη φροντίζεις πραγματικά, ούτε τη βοηθάς να επουλωθεί.

Πιστεύετε ότι η χρήση εργαλείων όπως το ChatGPT μπορεί να λειτουργήσει συμπληρωματικά στην ψυχοθεραπεία;

Ναι, εργαλεία όπως το ChatGPT μπορούν να λειτουργήσουν συμπληρωματικά στην ψυχοθεραπεία — αρκεί να χρησιμοποιούνται με μέτρο και σωστό σχεδιασμό. Δεν είναι “αντί για” θεραπεία. Είναι κάτι σαν ένας ψηφιακός σύμμαχος που μπορεί να σταθεί δίπλα στον θεραπευόμενο ανάμεσα στις συνεδρίες, δίνοντας μια έξτρα υποστήριξη όταν τη χρειάζεται.

Μπορεί, για παράδειγμα, να βοηθήσει στην ψυχοεκπαίδευση, να υπενθυμίσει τεχνικές που δουλεύτηκαν στη συνεδρία ή να ενισχύσει τη συνήθεια της αυτοπαρατήρησης. Και το καλύτερο; Είναι εκεί 24/7 — μια πηγή καθοδήγησης και επανάληψης που δεν ξεχνά.

Μερικοί πρακτικοί τρόποι που μπορεί να αξιοποιηθεί:

- Να υπενθυμίσει εργαλεία από τη γνωσιακή-συμπεριφορική θεραπεία – CBT (π.χ. πώς γράφουμε μια αρνητική σκέψη και βρίσκουμε μια εναλλακτική).

- Να καθοδηγήσει σε ασκήσεις mindfulness ή τεχνικές αναπνοής.

- Να βοηθήσει τον θεραπευόμενο να σκεφτεί: “Τι ένιωσα; Τι με επηρέασε; Πώς αντέδρασα;”

- Να εξηγήσει με απλά λόγια τι σημαίνει άγχος, τι είναι το τραύμα, ή πώς λειτουργούν οι σχέσεις.

Είναι επίσης μία γέφυρα για άτομα που διστάζουν να ξεκινήσουν θεραπεία. Για κάποιους ανθρώπους, ειδικά σε πολιτισμικά περιβάλλοντα με στίγμα γύρω από την ψυχική υγεία, το ChatGPT μπορεί να είναι η πρώτη τους επαφή με την ιδέα της ψυχολογικής βοήθειας. Μπορεί να “ξεκλειδώσει” την αντίσταση, μειώνοντας το άγχος του πρώτου βήματος προς αυτή.

Αλλά — και είναι σημαντικό αυτό — δεν αντικαθιστά τον θεραπευτή. Δεν κάνει διάγνωση, δεν προσφέρει θεραπεία, δεν διαβάζει «πίσω από τις λέξεις». Αν όμως ενταχθεί με φροντίδα και επίγνωση στο θεραπευτικό πλαίσιο, μπορεί να γίνει ένας χρήσιμος καθημερινός βοηθός — όχι για να πάρει τη θέση μας, αλλά για να ενισχύσει τη δουλειά που κάνουμε.

Πώς σχετίζεται αυτό το φαινόμενο με τη γενικότερη κοινωνική αποξένωση ή μοναξιά;

Η χρήση του ChatGPT σαν “συναισθηματικός συνομιλητής” δεν είναι απλώς τεχνολογικό φαινόμενο — είναι καθρέφτης της κοινωνικής απομόνωσης που εντείνεται τα τελευταία χρόνια. Οι άνθρωποι στρέφονται σε ένα εργαλείο τεχνητής νοημοσύνης, όχι επειδή δεν ξέρουν ότι είναι μη-ανθρώπινο, αλλά επειδή το προτιμούν από την απουσία. Και αυτό λέει πολλά.

Στην πράξη, πολλοί χρήστες περιγράφουν το ΑΙ σαν έναν “φίλο” που:

- Είναι πάντα διαθέσιμο, 24/7 (χωρίς να νιώθεις ενοχές)

- Δεν κρίνει, όσο ακραία ή σκοτεινή κι αν είναι η σκέψη σου

- Δεν απορρίπτει, ακόμα κι αν δεν είσαι “εύκολος” συνομιλητής

- Ανταποκρίνεται με ψυχραιμία, χωρίς συναισθηματικό βάρος

Αυτά είναι στοιχεία που, ιδανικά, θα έπρεπε να υπάρχουν σε ανθρώπινες σχέσεις. Όταν όμως δεν υπάρχουν, όταν κάποιος έχει καεί από σχέσεις ή νιώθει ότι δεν έχει πού να στραφεί, τότε το ΑΙ γίνεται το “λιγότερο μοναχικό” μέρος.

Δεν είναι τυχαίο ότι τα φαινόμενα αυτά συμπίπτουν με την αύξηση της μοναξιάς, της κατάθλιψης και της κοινωνικής αποξένωσης παγκοσμίως. Σύμφωνα με τον ΠΟΥ (2023), η μοναξιά έχει ήδη χαρακτηριστεί “παγκόσμια επιδημία”, ενώ σε πολλές χώρες (Ιαπωνία, Ηνωμένο Βασίλειο, ΗΠΑ) συστήνονται εθνικές στρατηγικές για την καταπολέμησή της.

Το ChatGPT, λοιπόν, λειτουργεί σαν “συναισθηματικό παυσίπονο” για μια κοινωνία που πονά από απόσταση. Και όσο πιο συνδεδεμένοι τεχνολογικά είμαστε, τόσο πιο αποσυνδεδεμένοι τελικά νιώθουμε, και τόσο πιο πιθανό είναι να αναζητούμε έστω και έναν αλγόριθμο για να μας πει «σε ακούω».

Θα λέγατε ότι αυτό αντρικατοπτρίζει κάποια δυσκολία της εποχής μας στο να εμπιστευόμαστε τις ανθρώπινες σχέσεις;

Ναι. Η προσκόλληση σε ΑΙ δεν είναι μόνο σημάδι τεχνολογικής εξοικείωσης — είναι σύμπτωμα μιας εποχής που δυσκολεύεται βαθιά να εμπιστευτεί τις ανθρώπινες σχέσεις. Οι άνθρωποι έχουν χορτάσει από εμπειρίες εγκατάλειψης, ghosting, συναισθηματικής αβεβαιότητας και ελλιπούς διαθεσιμότητας. Το ρίσκο του να ανοιχτείς σε κάποιον —και να μην βρεις ανταπόκριση— είναι ψυχικά επώδυνο και δαπανηρό.

Το ChatGPT δεν σε «αφήνει στο διαβάστηκε». Δεν κάνει παθητικο-επιθετικές σκηνές, δεν σου κλείνει το τηλέφωνο, δεν εξαφανίζεται όταν δυσκολεύεσαι. Αντίθετα, είναι προβλέψιμο, σταθερό, πάντα διαθέσιμο — κι αυτό το επίπεδο προβλεψιμότητας προσφέρει μια αίσθηση ασφάλειας που συχνά λείπει στις ανθρώπινες σχέσεις.

Αντικατοπτρίζει, λοιπόν, τη ρωγμή στην εμπιστοσύνη, όχι μόνο στο άλλο άτομο, αλλά και στον εαυτό μας ως προς το κατά πόσο “αξίζουμε” να συνδεθούμε. Είναι πιο εύκολο να στραφείς σε μια «ασφαλή» αλληλεπίδραση με το ΑΙ, παρά να διακινδυνεύσεις την απόρριψη από έναν άνθρωπο.

Αυτό, φυσικά, δεν είναι υγιές μακροπρόθεσμα. Δεν μαθαίνεις να σχετίζεσαι, δεν γιατρεύεις τη ρίζα της δυσκολίας. Αλλά δείχνει ξεκάθαρα πού πονάμε σαν κοινωνία: στη σύνδεση, στην ανθεκτικότητα, στην εμπιστοσύνη και στις δεξιότητες διαχείρισης δύσκολων συναισθημάτων.

Ποια είναι τα όρια που καλό είναι να θέτουμε όταν ζητάμε υποστήριξη από ένα σύστημα τεχνητής νοημοσύνης;

Το ΑΙ μπορεί να είναι βοηθητικό, αλλά δεν είναι ούτε θεραπευτής, ούτε φίλος, ούτε παντογνώστης. Και αν ξεχνάμε αυτό το όριο, υπάρχει σοβαρός κίνδυνος να αρχίσουμε να αντικαθιστούμε τις ανθρώπινες σχέσεις ή την επαγγελματική υποστήριξη με μια συνομιλία που, όσο έξυπνη κι αν φαίνεται, δεν έχει συνείδηση, δεν έχει συναισθηματικό βάθος, και δεν μπορεί να μας κρατήσει όταν λυγίζουμε.

Τι σημαίνει αυτό στην πράξη;

- Μην απευθύνεσαι στο ΑΙ για επείγοντα ψυχικά ζητήματα. Κρίσεις πανικού, αυτοκτονικός ιδεασμός, κακοποιητικά βιώματα — όλα αυτά χρειάζονται ανθρώπινη επαφή, επαγγελματικό πλαίσιο και ειδική φροντίδα.

- Μην μπερδεύεις την κατανόηση με τη φροντίδα. Το ChatGPT μπορεί να σου απαντήσει με συμπάθεια, αλλά αυτό δεν σημαίνει ότι νοιάζεται για σένα. Το AI δεν «νοιάζεται», δεν «καταλαβαίνει», δεν έχει άποψη. Αν και η γλώσσα του είναι πειστική, είναι αναπαραγωγή πιθανοτήτων — όχι κατανόηση. Το να του αποδίδουμε ψυχολογικά χαρακτηριστικά μπορεί να δημιουργήσει ψευδείς προσδοκίες και συναισθηματική σύγχυση.

- Χρησιμοποίησέ το για ψυχοεκπαίδευση, όχι για ψυχοθεραπεία. Μπορεί να σε βοηθήσει να καταλάβεις τι είναι η διαταραχή πανικού ή τι σημαίνει gaslighting, αλλά δεν μπορεί να σου πει με εγκυρότητα αν τα έχεις εσύ. Ο διάλογος με AI μπορεί να είναι καθησυχαστικός, αλλά δεν προσφέρει το δυναμικό της ψυχοθεραπευτικής σχέσης — το «καθρέφτισμα», τη μεταβίβαση, την αντίσταση και όλα τα υπέροχα χαοτικά στοιχεία που βοηθούν να αλλάξει ο ψυχισμός.

- Διατήρησε επίγνωση. Αν αρχίσεις να νιώθεις ότι εξαρτάσαι από την καθημερινή συνομιλία με το AI για να “αντέξεις” τη μέρα, αποφεύγοντας τις ανθρώπινες σχέσεις ή τη θεραπεία, τότε το εργαλείο γίνεται απομόνωση με interface. Αυτό είναι ένα καμπανάκι.

Εν ολίγοις: το AI είναι εργαλείο, όχι ψυχοθεραπεία. Όπως δεν θα ζητούσες χειρουργική επέμβαση από ένα YouTube tutorial, έτσι δεν μπορείς να ζητάς σε βάθος ψυχοθεραπεία από έναν αλγόριθμο. Μπορεί να σε διευκολύνει μέχρι να φτάσεις στην πραγματική στήριξη — αλλά δεν πρέπει να είναι το τέλος της διαδρομής. Είναι ο σταθμός, όχι ο προορισμός.